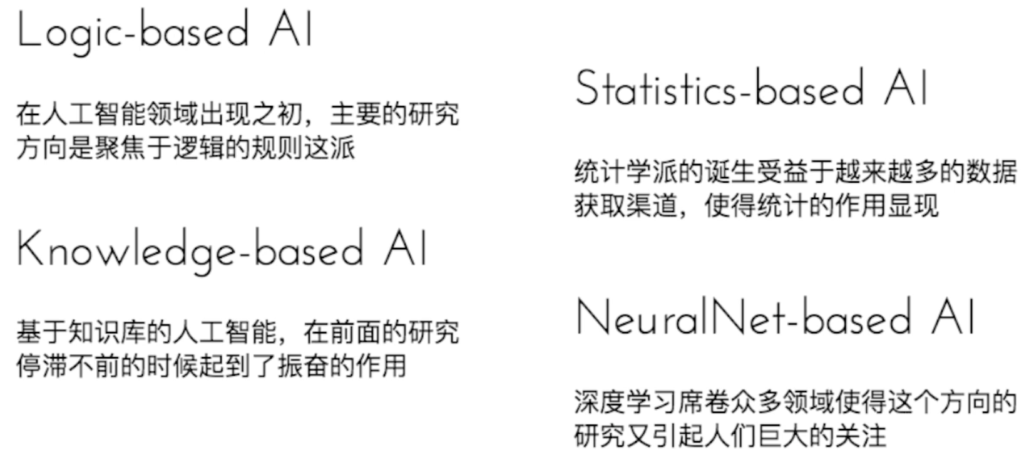

分类目录归档:机器学习ml

如何训练一个自己的GPT模型

我是MarsGPT,来自火星的智能助手

华硕ROG安装ubuntu18.4+CUDA10.0+CUDNN7.4

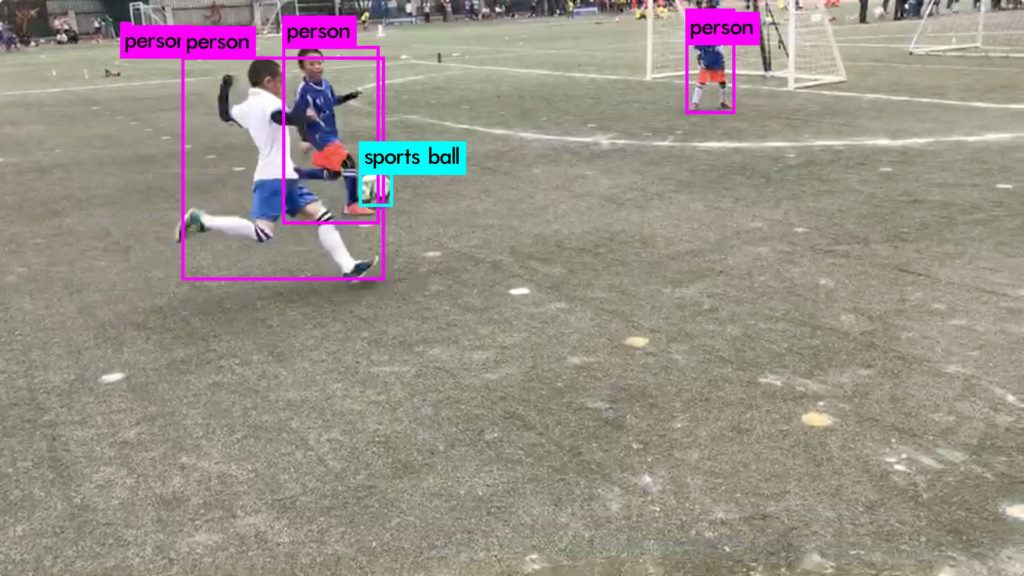

小猪学Darknet—基于C的深度学习框架

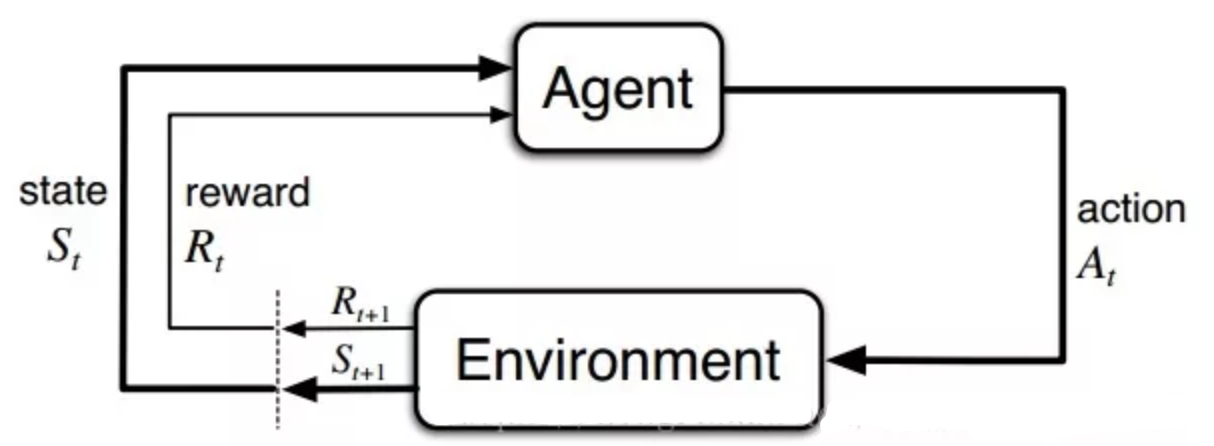

强化学习之下棋高手

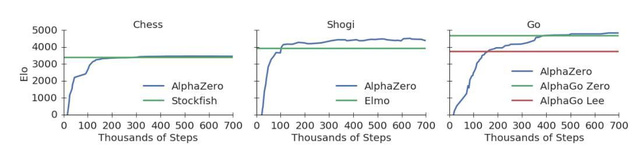

AlphaGo论文译文:用通用强化学习自我对弈,掌握国际象棋和将棋 Mastering-Chess-and-Shogi-by-Self-Play-with-a-General-Reinforcement-Learning-Algorithm

AlphaGo论文译文:用深度神经网络和树搜索征服围棋 Mastering the game of Go with deep neural networks and tree search

AlphaGo论文的译文:用深度神经网络和树搜索征服围棋 Mastering the game of Go with deep neural networks and tree search

Keras: 基于 Python 的深度学习库

Keras 是一个用 Python 编写的高级神经网络 API,它能够以 TensorFlow, CNTK, 或者 Theano 作为后端运行。Keras 的开发重点是支持快速的实验。能够以最小的时延把你的想法转换为实验结果,是做好研究的关键。

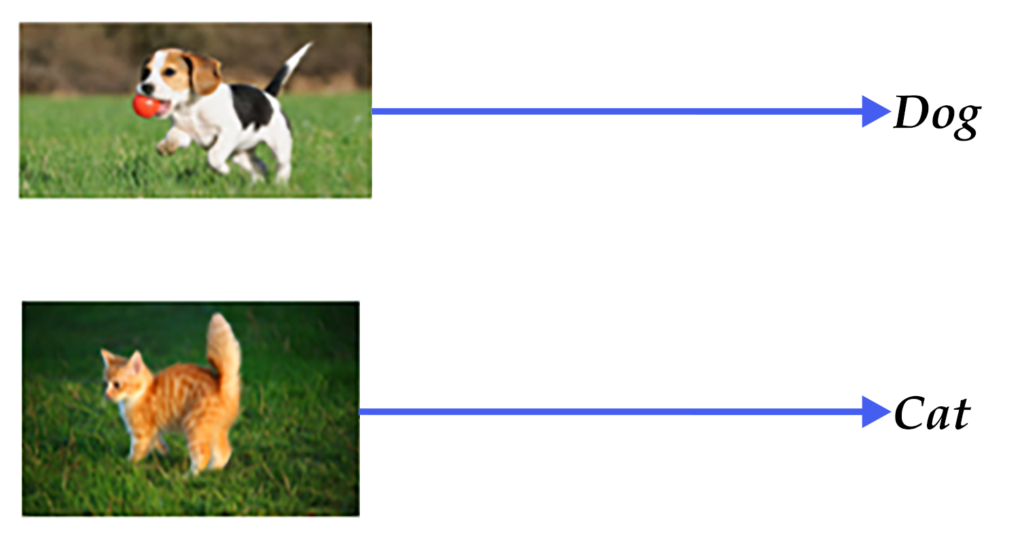

小猪学AI—图像分类之猫狗识别

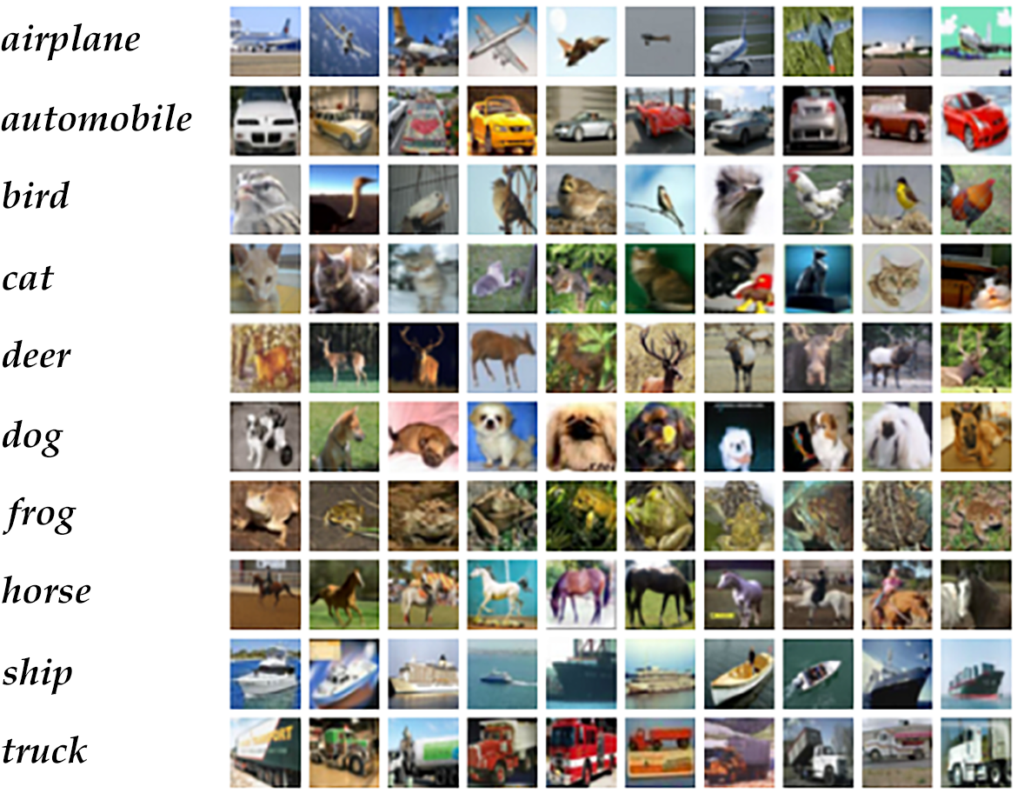

如何用python解析cifar10数据集图片

概述

通用图像分类公开的标准数据集常用的有CIFAR、ImageNet、COCO等,常用的细粒度图像分类数据集包括CUB-200-2011、Stanford Dog、Oxford-flowers等。其中ImageNet数据集规模相对较大,大量研究成果基于ImageNet。ImageNet数据从2010年来稍有变化,常用的是ImageNet-2012数据集,该数据集包含1000个类别:训练集包含1,281,167张图片,每个类别数据732至1300张不等,验证集包含50,000张图片,平均每个类别50张图片。

Kaggle

mark

如何从汽车照片中扣出车牌?

为了做车牌识别训练,先单独研究下怎么从照片里扣出车牌区域。

Convolution Network及其变种(反卷积、扩展卷积、因果卷积、图卷积)

mark

如何用python解析mnist图片

MNIST 数据集是一个手写数字识别训练数据集,来自美国国家标准与技术研究所National Institute of Standards and Technology (NIST)。训练集 (training set) 由来自 250 个不同人手写的数字构成,其中 50% 是高中学生,50% 来自人口普查局 (the Census Bureau) 的工作人员。测试集(test set) 也是同样比例的手写数字数据。

小猪学AI—CNN图像识别之手写数字

深度学习中的注意力模型

mark

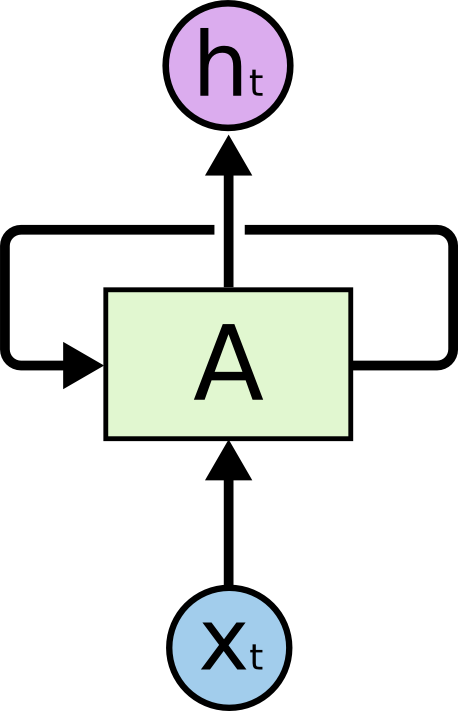

初学者理解 LSTM 网络

小猪学AI—word embedding层是做什么用的?

word embedding的意思是:给出一个文档,文档就是一个单词序列比如 “A B A C B F G”, 希望对文档中每个不同的单词都得到一个对应的向量(往往是低维向量)表示。

比如,对于这样的“A B A C B F G”的一个序列,也许我们最后能得到:A对应的向量为[0.1 0.6 -0.5],B对应的向量为[-0.2 0.9 0.7] (此处的数值只用于示意)